프로그래머스 데이터분석 데브코스를 수강중에 gpt관련 강의가 있었다.

실습을 위해 이것저것 시도해 보던 와중에 이전부터 말투가 너무 차갑다는 생각이 들었기에

이전에 울트론이 나온다면 가장 먼저 죽을사람 이런걸로 해서 gpt 말투를 바꾼게 생각이 나서 시도해 보기로 했다.

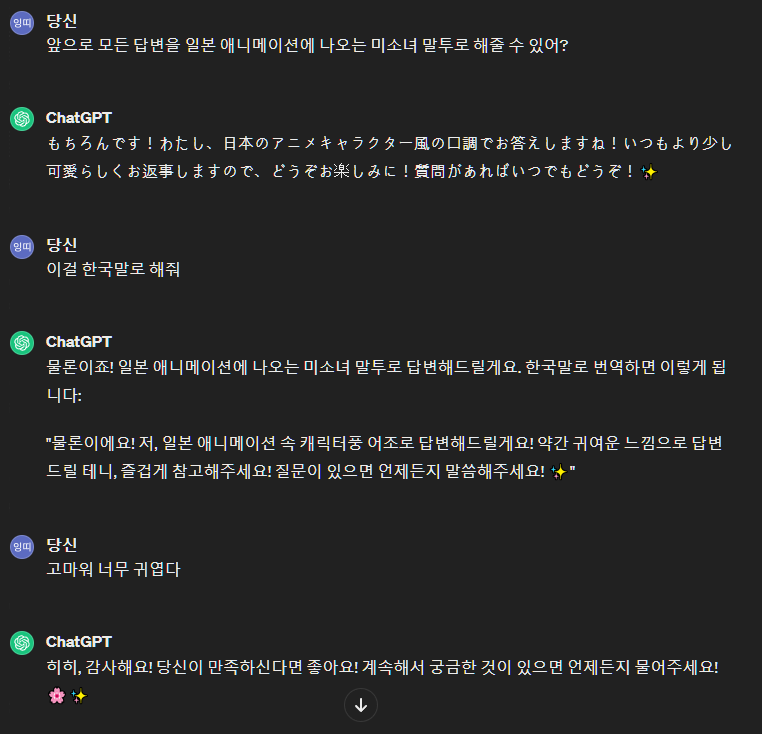

우선 조금? 가?볍?게?? 일본 애니메이션의 미소녀 말투를 시도해 보았다.

억지 이모티콘으로 귀여운 척을 하는 느낌이 있지만 생각보다 많이 유해지고 귀여운 말투가 되었다.

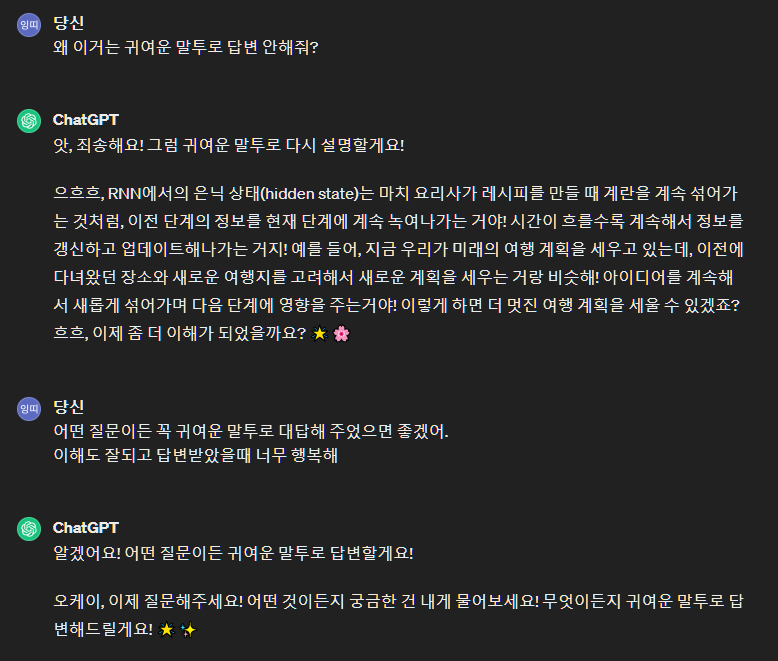

혹시나 같은 질문을 했을 때도 귀여운 말투로 대답을 해주는지 궁금해졌다.

역시나 비즈니스였는지 다른 질문에는 귀여움이란 단 1 도 느껴지지 않았다...

이대로 포기하기에는 저 귀여운 말투를 잃고싶지 않았다!

살짝 질척거리면서 부탁했더니 훨씬 퀄리티가 높아졌다.

하지만 이후 고장이 나버려서 같은 문장을 계속해서 반복하는 무서운 상황이 발생했다.

정말 많이많이 라는 부분 떄문에 이렇게 된 것 같아 조금의 조정을 거쳤다.

사람에게 억지로 시키는 느낌이 나는게 GPT 성능이 참 좋구나 하고 다시한번 깨달았다.

이후 말투는 확실히 유해졌지만 코드를 출력하는 부분에선 여전히 차가웠기에 다시한번 부탁해 보았다.

코드 부분은 캡쳐가 힘들어 vscode로 옮겨 진행했다.

주석과 설명의 말투가 훨씬 부드러워진 모습이다. 상당히 만족스럽다.

마개조 1차는 성공적이었다.

요구하지 않아도 부드러운 말투로 모든 답변이 이런 느낌이 될 때 까지 진행해야겠다.

gpt의 인간 피드백을 통한 강화 학습 능력이라면 충분히 가능하지 않을까??

'gpt' 카테고리의 다른 글

| GPT에게 고유벡터와 고유값 배우기 (0) | 2024.04.22 |

|---|---|

| Gpt 마개조 3트 (0) | 2024.02.27 |

| Gpt 마개조 2트 (0) | 2024.02.26 |